隨著人工智能進入新時代,大語言模型(Large Language Models, LLMs)已成為技術創新的核心驅動力之一。其發展與演進,不僅體現了算法和數據的突破,更是計算機軟硬件技術深度協同開發的典范。

一、大語言模型的技術演進路徑

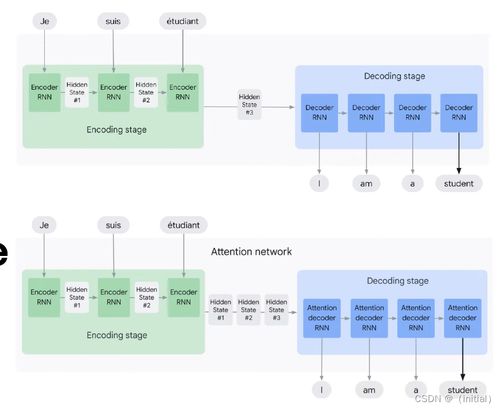

大語言模型的發展經歷了從統計語言模型到神經語言模型,再到如今基于Transformer架構的預訓練大模型的飛躍。早期模型受限于計算能力和數據規模,功能較為單一。2017年Transformer架構的提出是關鍵轉折點,其自注意力機制有效解決了長距離依賴問題。GPT、BERT等模型開創了“預訓練-微調”范式,通過在海量無標注文本上學習通用語言表示,再針對特定任務進行微調,極大提升了模型的泛化能力和效率。模型規模呈現指數級增長,從億級參數發展到萬億參數,出現了如GPT-3、PaLM、GPT-4等標志性模型。技術演進的核心趨勢是“規模擴大”(Scaling Law),即模型性能隨參數數量、訓練數據和計算量的增加而可預測地提升。技術重點也從單純的規模擴展,轉向提升訓練效率(如混合精度訓練、優化器改進)、探索更高效的架構(如稀疏專家混合模型MoE)、以及追求更好的對齊能力與安全性。

二、硬件開發的強力支撐與挑戰

大語言模型的演進極度依賴底層硬件算力的突破。圖形處理器(GPU)及其專用張量核心是訓練和推理的基石。英偉達的A100、H100等GPU,憑借其高帶寬內存(HBM)和高速互連技術(如NVLink),為千億級參數的模型訓練提供了可能。更進一步的,針對AI負載的專用芯片(ASIC),如谷歌的TPU,通過優化矩陣運算,實現了更高的能效比。

硬件開發面臨的核心挑戰是“內存墻”和“功耗墻”。超大模型參數需要巨大的存儲和高速訪問,推動了高帶寬內存、異構內存架構以及CPU-GPU協同技術的發展。訓練一個大型模型能耗巨大,催生了液冷、沉浸式冷卻等先進散熱方案,以及從芯片到數據中心級別的能效優化設計。存算一體、光計算等新型計算范式可能成為突破現有瓶頸的關鍵。

三、軟件開發的關鍵作用與創新

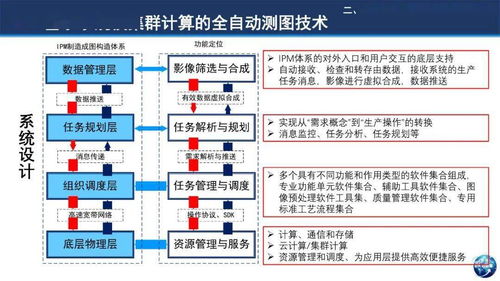

在硬件之上,復雜的軟件棧是將算力轉化為模型能力的關鍵。框架層,如PyTorch和TensorFlow,提供了靈活的自動微分和動態圖計算,極大簡化了模型研發。分布式訓練框架(如DeepSpeed、FairScale)通過數據并行、模型并行、流水線并行等策略,實現了超大規模模型在多機多卡集群上的高效訓練,解決了單卡內存不足和訓練時長的問題。

編譯與優化工具(如TVM、TensorRT)將訓練好的模型高效部署到各種硬件平臺,進行推理優化,降低延遲和成本。龐大的開源生態(如Hugging Face Transformers庫)提供了模型、數據集和工具鏈,大幅降低了研究和應用門檻。軟件開發的創新方向包括:更智能的分布式調度、自動混合并行策略、無損或低損的模型壓縮與量化技術,以及統一的多框架、多硬件后端支持。

四、軟硬件協同開發的未來展望

大語言模型未來的發展將更加依賴軟硬件的協同設計與深度優化。硬件方面,計算架構將更貼近AI負載特征,可能出現更多“模型感知”或“算法感知”的定制化芯片。軟件方面,系統將更智能地進行資源管理和任務調度,實現計算、存儲、通信的極致平衡。

一個重要的趨勢是“全棧優化”——從算法模型設計開始,即考慮目標硬件平臺的特性(如內存層次、計算單元),編譯器中間表示(IR)與神經網絡表示(如ONNX)的融合,以及運行時系統的自適應優化。這種垂直整合,旨在消除各層級間的抽象損耗,釋放硬件最大潛力。

結論:大語言模型的技術演進是一部算法、數據、算力三者交織前進的歷史。計算機軟硬件技術不僅是其發展的“土壤”和“引擎”,其本身也在模型需求的強力驅動下不斷革新。兩者相互促進,共同推動著人工智能向更通用、更高效、更易用的方向邁進。未來的突破,必將誕生于算法創新與軟硬件協同開發的更深度融合之中。